O avanço acelerado de ferramentas como o ChatGPT reacende debates sobre ética, regulação e impacto no trabalho. Entre ganhos de produtividade e riscos de desinformação, governos e empresas correm para definir limites claros até 2026.

A inteligência artificial já impacta até 40% dos empregos globais, segundo organismos internacionais.

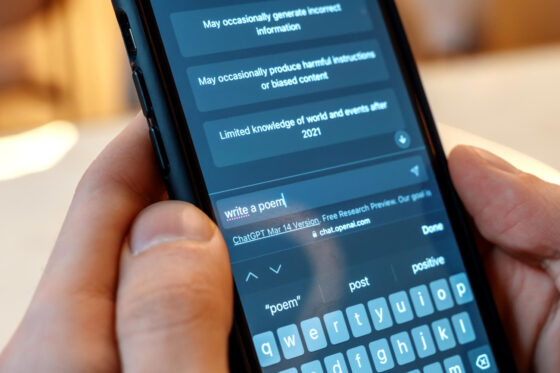

Desde o lançamento do ChatGPT, desenvolvido pela OpenAI, em 2022, a inteligência artificial generativa deixou de ser uma promessa e passou a integrar rotinas profissionais, educacionais e pessoais.

Até 2026, ferramentas baseadas em IA já são amplamente utilizadas para redação de textos, programação, análise de dados, atendimento ao cliente e produção de conteúdo. Grandes empresas de tecnologia, como a Microsoft, ampliaram investimentos bilionários no setor, incorporando IA em plataformas como Office, Azure e buscadores.

Relatórios recentes de instituições como o Fundo Monetário Internacional (FMI) e a Organização Internacional do Trabalho (OIT) indicam que até 40% dos empregos globais podem ser impactados pela IA, seja por automação parcial ou transformação de funções.

Entre produtividade e substituição: impacto no trabalho

A adoção da IA trouxe ganhos expressivos de produtividade. Estudos do MIT e da Universidade de Stanford mostram que profissionais que utilizam ferramentas como ChatGPT podem aumentar sua eficiência em tarefas de escrita e análise em até 30% a 50%.

Por outro lado, cresce a preocupação com a substituição de atividades intelectuais. Áreas como jornalismo, marketing, atendimento e educação estão entre as mais impactadas.

Nos Estados Unidos, empresas já utilizam IA para triagem de currículos, atendimento automatizado e produção de relatórios. No Brasil, a tecnologia também avança em setores como serviços, educação e comunicação.

Especialistas apontam que o risco não está necessariamente na eliminação de empregos, mas na reconfiguração do mercado de trabalho, exigindo novas habilidades, como pensamento crítico, curadoria de informação e domínio de ferramentas digitais.

Educação: ferramenta ou atalho?

O uso da IA no ambiente educacional continua sendo um dos pontos mais sensíveis.

Inicialmente, redes públicas como as de Nova York restringiram o uso da tecnologia. No entanto, até 2026, muitas dessas políticas foram revistas para incorporar a IA como ferramenta pedagógica.

Hoje, universidades e escolas adotam abordagens híbridas:

- uso permitido com transparência;

- exigência de declaração de uso de IA em trabalhos;

- desenvolvimento de avaliações presenciais e orais.

A principal preocupação permanece: o uso da IA como substituto do aprendizado, e não como apoio.

Limitações e riscos da tecnologia

Apesar dos avanços, a IA ainda apresenta limitações relevantes:

- Alucinações: geração de informações incorretas com aparência convincente

- Viés algorítmico: reprodução de desigualdades presentes nos dados

- Falta de contexto: dificuldade em interpretar nuances culturais e sociais

- Dependência excessiva: risco de redução do pensamento crítico

Pesquisas do Pew Research Center indicam que uma parcela significativa da população ainda desconfia da confiabilidade da IA, especialmente em áreas sensíveis como saúde, justiça e informação política.

Regulação: o mundo tenta impor limites

Até 2026, diferentes países avançaram na tentativa de regular o uso da inteligência artificial:

União Europeia

Aprovou o AI Act, uma das legislações mais abrangentes do mundo, que classifica sistemas de IA por nível de risco e impõe regras rigorosas para usos considerados críticos.

Estados Unidos

Adotaram uma abordagem mais descentralizada, com diretrizes federais e legislações estaduais, além de iniciativas como o “AI Bill of Rights”, focado em direitos civis e proteção de dados.

Brasil

O Congresso Nacional discute o marco regulatório da IA, inspirado em modelos europeus, com foco em transparência, responsabilidade e proteção de direitos fundamentais.

O limite: onde termina a ferramenta e começa o risco?

O debate atual não é mais sobre “usar ou não usar” inteligência artificial — mas como usar de forma responsável.

Especialistas convergem em alguns pontos-chave:

- a IA deve ser assistiva, não substitutiva em decisões críticas;

- é essencial garantir transparência no uso;

- conteúdos gerados devem ser verificados por humanos;

- usuários precisam desenvolver alfabetização digital e crítica.

Como resumem analistas do setor, o limite da IA não está apenas na tecnologia, mas na forma como a sociedade decide utilizá-la.

*Aprenda mais sobre marketing de conteúdo, produção de vídeo para pequenas empresas, design, SEO e até desenvolvimento web visitando nosso outro website com foco em Marketing, Negócios e Empreendedorismo e – www.kisuccess.com

FAQ – Perguntas Frequentes

1. O ChatGPT pode substituir profissionais?

Não completamente. Ele pode automatizar tarefas, mas ainda depende de supervisão humana, especialmente em atividades complexas.

2. É permitido usar IA em trabalhos escolares?

Depende da instituição. Muitas permitem, desde que o uso seja declarado e não substitua o aprendizado.

3. A IA pode gerar informações falsas?

Sim. Esse fenômeno é conhecido como “alucinação” e exige verificação das respostas.

4. Existe regulamentação sobre IA no Brasil?

Ainda em discussão no Congresso, com propostas inspiradas no modelo europeu.

5. Usar IA no trabalho é antiético?

Não necessariamente. Torna-se problemático quando há falta de transparência ou uso indevido.